DeepSeek 的第一代推理模型,在数学、代码和推理任务中实现了与 OpenAI-o1 相当的性能。

模型

DeepSeek-R1

ollama run deepseek-r1:671b

提炼模型

DeepSeek 团队已经证明,较大模型的推理模式可以提炼为较小的模型,从而获得比在小模型上通过 RL 发现的推理模式更好的性能。

以下是使用 DeepSeek-R1 生成的推理数据,针对研究界广泛使用的几种密集模型进行微调而创建的模型。评估结果表明,提炼出的较小密集模型在基准测试中表现优异。

DeepSeek-R1-Distill-Qwen-1.5B

ollama run deepseek-r1:1.5b

DeepSeek-R1-Distill-Qwen-7B

ollama run deepseek-r1:7b

DeepSeek-R1-Distill-Llama-8B

ollama run deepseek-r1:8b

DeepSeek-R1-Distill-Qwen-14B

ollama run deepseek-r1:14b

DeepSeek-R1-Distill-Qwen-32B

ollama run deepseek-r1:32b

DeepSeek-R1-Distill-Llama-70B

ollama run deepseek-r1:70b

执照

模型权重遵循 MIT 许可。DeepSeek-R1 系列支持商业使用,允许任何修改和衍生作品,包括但不限于用于训练其他 LLM 的蒸馏。请注意:

Qwen 提炼模型源自 Qwen-2.5 系列,该系列最初获得 Apache 2.0 许可,现在使用 DeepSeek-R1 精选的 800k 个样本进行了微调。

Llama 8B 精简模型源自 Llama3.1-8B-Base,最初获得 llama3.1 许可。

Llama 70B 精简模型源自 Llama3.3-70B-Instruct,最初获得 llama3.3 许可。

1、本地部署,我们可以通过Ollama来进行安装Ollama 官方版:【点击前往】

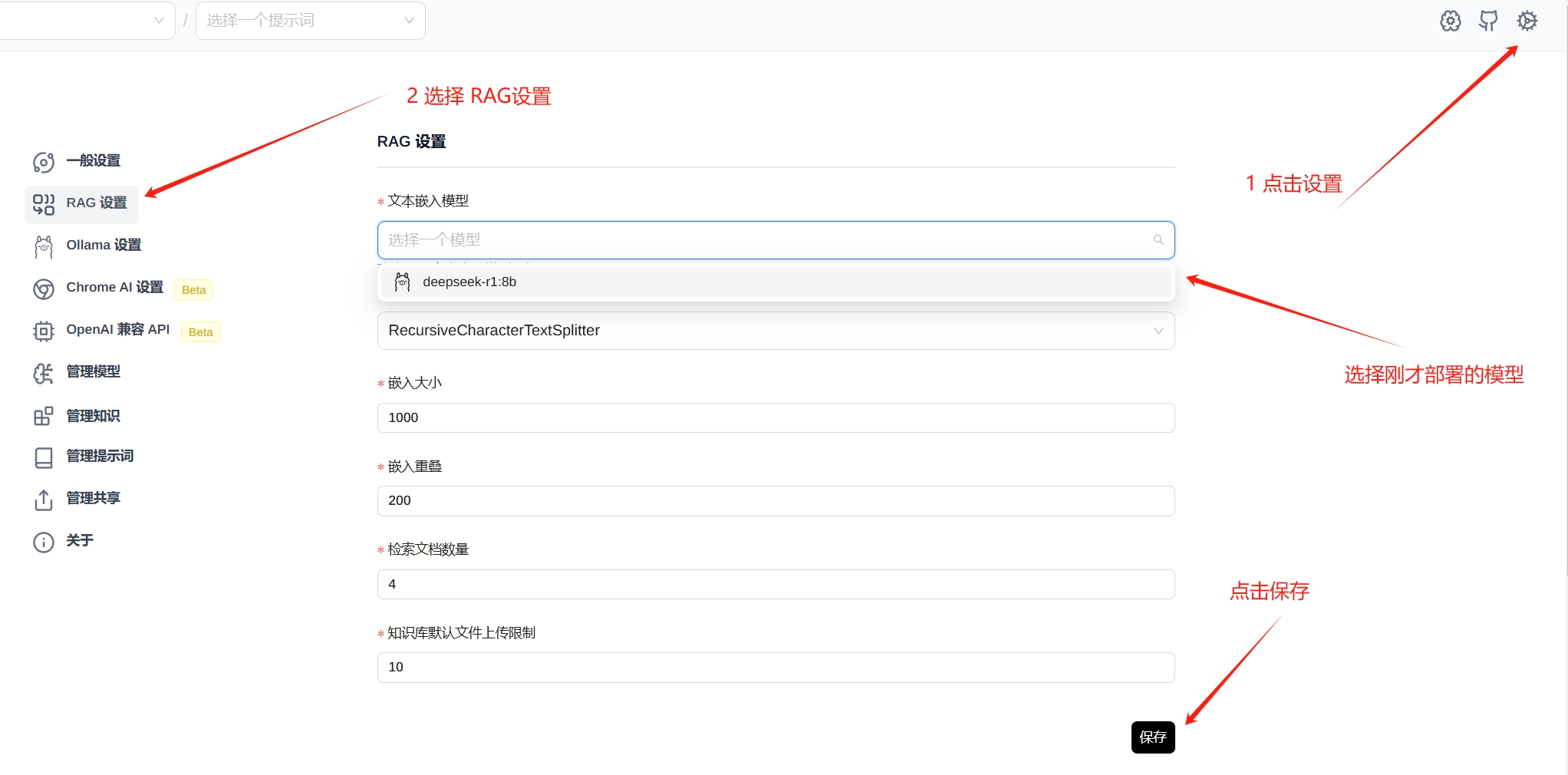

Web UI 控制端【点击安装】

安装命令

1.5B Qwen DeepSeek R1

ollama run deepseek-r1:1.5b

7B Qwen DeepSeek R1

ollama run deepseek-r1:7b

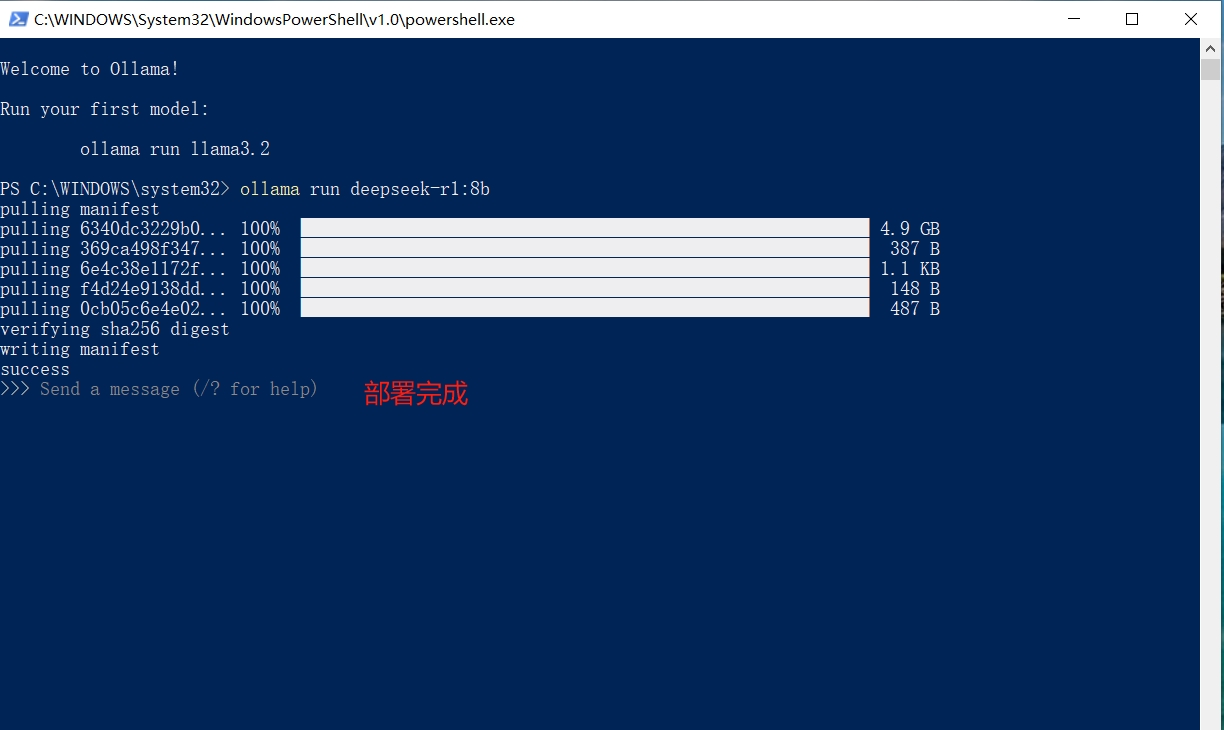

8B Llama DeepSeek R1

ollama run deepseek-r1:8b

14B Qwen DeepSeek R1

ollama run deepseek-r1:14b

32B Qwen DeepSeek R1

ollama run deepseek-r1:32b

70B Llama DeepSeek R1

ollama run deepseek-r1:70b

2.Web UI 控制端设置